La Tribuna, guerra nuclear, IA

La disuasión nuclear ya no es un juego de dos jugadores, y las tecnologías emergentes amenazan aún más el statu quo. El resultado es una nueva y arriesgada era nuclear.

17 julio 2025.- El Reloj del Juicio Final —un árbitro simbólico de lo cerca que está la humanidad de aniquilarse a sí misma— se encuentra ahora a 89 segundos de la medianoche, más cerca que nunca de señalar el punto de no retorno de nuestra especie.

Numerosas amenazas, como el cambio climático y las armas biológicas , impulsaron a los especialistas en seguridad global del Bulletin of the Atomic Scientists de Chicago, Illinois, a adelantar el reloj en enero. Pero el principal de esos peligros es el creciente —y a menudo ignorado— riesgo de guerra nuclear.

Desde la intensa guerra de Rusia en Ucrania y las tensiones latentes entre India y Pakistán que estallaron en mayo, hasta los ataques de Estados Unidos e Israel a las instalaciones nucleares de Irán en junio, en el mundo no faltan conflictos que involucran a una o más naciones con armas nucleares.

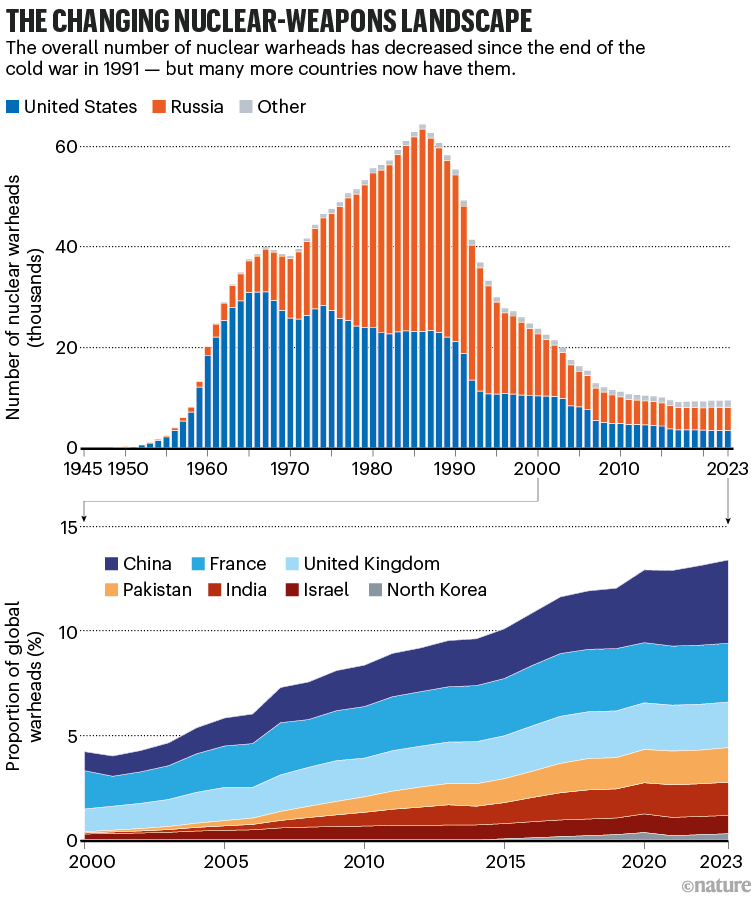

Pero no es solo la cantidad de enfrentamientos con potencial de escalada lo que causa consternación. La anterior gran acumulación de armas nucleares, la Guerra Fría entre Estados Unidos y la Unión Soviética, involucró esencialmente a dos superpotencias razonablemente equiparables. Ahora, China emerge como la tercera superpotencia con armas nucleares, Corea del Norte aumenta su arsenal nuclear e Irán ha enriquecido uranio más allá de lo necesario para uso civil. Se cree que India y Pakistán también están expandiendo sus arsenales nucleares. Si a esto le sumamos el potencial de que la desinformación en línea influya en líderes o votantes de naciones con armas nucleares, y de que la inteligencia artificial (IA) genere incertidumbre en la toma de decisiones militares, queda claro que las reglas se han roto.

En medio de este panorama tenso, los científicos trabajan para evitar la aniquilación del mundo . En una conferencia de tres días en Chicago, que comenzó el 14 de julio —casi exactamente 80 años después de que investigadores y el ejército estadounidense probaran la primera arma atómica—, decenas de científicos, incluidos premios Nobel de diversas disciplinas, se reunieron para debatir medidas para prevenir una guerra nuclear. Lanzaron una nueva advertencia sobre sus riesgos, así como recomendaciones sobre cómo la sociedad puede reducirlos, incluyendo un llamado a todas las naciones para que se comuniquen con transparencia sobre las implicaciones científicas y militares de la IA.

El amanecer de una era nuclear

El emergente mundo multipolar trastoca un principio de seguridad nuclear que ayudó a evitar una guerra nuclear en el pasado. Los principios de la disuasión nuclear se basan en la suposición de que ninguna nación desea iniciar una guerra con consecuencias devastadoras para todos. Esto implicaba tener arsenales nucleares distribuidos que no podían destruirse de un solo golpe, lo que reducía cualquier incentivo para atacar primero, sabiendo que el enemigo contraatacaría y la consecuencia sería una «destrucción mutua asegurada». También implicaba claridad entre las naciones con armas nucleares sobre quién tenía qué capacidad de ataque y, por lo tanto, cuáles serían las posibles consecuencias de cualquier ataque. Prevalecía una frágil estabilidad, gracias a las comunicaciones indirectas entre naciones hostiles y a las señales diplomáticas diseñadas para evitar malentendidos que pudieran llevar a la pulsación accidental del botón nuclear.

El modelo multipolar es más complejo, lo que dificulta la gestión de las comunicaciones. La existencia de más potencias nucleares también plantea la posibilidad de guerras nucleares más pequeñas que, aun así, serían totalmente devastadoras, pero que no necesariamente conducirían a una destrucción mutua asegurada, lo que debilitaría el efecto disuasorio de atacar primero.

Es más, muchas de las comunicaciones extraoficiales que existían para ayudar a desactivar las tensiones nucleares, como las conversaciones informales entre científicos estadounidenses y soviéticos durante la Guerra Fría, ya no se llevan a cabo en la misma medida . Los canales diplomáticos formales también se están desgastando, estancando o interrumpiendo por conflictos modernos como la guerra entre Israel e Irán. El hecho más preocupante es la tendencia actual a la competencia en lugar de la cooperación, en la ciencia y en las relaciones internacionales.

Algunos llaman al mundo multipolar una tercera era nuclear. La primera fue la Guerra Fría, desde las secuelas de la Segunda Guerra Mundial hasta el colapso de la Unión Soviética en 1991; y la segunda fue durante las décadas de 1990 y 2000, cuando Estados Unidos y Rusia redujeron sus arsenales nucleares (véase «El cambiante panorama de las armas nucleares»).

La nube de desinformación

El poder de internet y las redes sociales para amplificar la desinformación —y su pariente cercano, la desinformación, la difusión deliberada de información falsa— solo agrava la fragilidad de la nueva situación. Ambos pueden empañar los delicados debates sobre la disuasión nuclear y aumentar el riesgo de una escalada militar.

Tomemos como ejemplo el conflicto entre India y Pakistán en mayo, que comenzó cuando India lanzó ataques contra Pakistán tras un ataque terrorista. Pakistán respondió y ambos países se lanzaron misiles y otras armas mutuamente, con bajas en ambos bandos. Las noticias y las redes sociales se inundaron de falsas afirmaciones de triunfo militar, incluyendo imágenes generadas por inteligencia artificial que pretendían mostrar objetivos enemigos destruidos. Los especialistas en seguridad global temían que la desinformación sobre la magnitud de la destrucción pudiera desencadenar una escalada hacia una guerra nuclear.

Eso no sucedió: tras cuatro días de conflicto, India y Pakistán acordaron un alto el fuego tras la presión de Estados Unidos. Pero no es difícil imaginar cómo la desinformación podría empujar al líder de una nación con armas nucleares a decidir usarlas. Por ejemplo, un actor deshonesto que desee causar problemas podría iniciar un rumor falso en redes sociales con el objetivo de convencer a los consumidores de noticias estadounidenses de que Irán ha construido un arma nuclear. Dichos temores podrían entonces filtrarse a los medios de comunicación que son vigilados de cerca por el presidente de Estados Unidos y terminar influyendo en sus acciones.

Niebla de guerra de IA

Otro tema emergente es el papel que la IA podría desempeñar en las decisiones sobre si se debe o no usar un arma nuclear y cómo hacerlo. El Departamento de Defensa de EE. UU. utiliza herramientas de IA para la planificación y las operaciones en el campo de batalla en la guerra convencional. Su principal responsable de las fuerzas nucleares, el general de la Fuerza Aérea Anthony Cotton, declaró el año pasado que la IA puede ayudar a agilizar las decisiones de mando y control nuclear.

Las empresas de IA han iniciado colaboraciones con el ejército estadounidense. En junio, Anthropic, con sede en San Francisco, California, anunció un conjunto de modelos clasificados de Claude Gov, basados en su asistente de IA Claude, disponible públicamente, que se utilizarán para las necesidades de seguridad nacional de EE.UU. En enero, OpenAI, también con sede en San Francisco, anunció una colaboración con laboratorios nacionales estadounidenses que incluye la integración de los modelos de la empresa en el ámbito de las armas nucleares. Según informes, China y Rusia también están integrando herramientas de IA en la guerra convencional y nuclear .

Diversos países llevan mucho tiempo utilizando algoritmos basados en IA para optimizar y acelerar tareas específicas, como la identificación y el seguimiento de posibles misiles nucleares entrantes. La novedad reside en el uso de modelos de razonamiento de IA . Estos modelos, similares al o3 de OpenAI o a los que sustentan a Claude, pueden generalizarse en diversas tareas y agilizar el procesamiento de grandes cantidades de datos, además de que probablemente se integren en los sistemas de alerta temprana y recopilación de inteligencia de muchos países.

Cuando estalló el conflicto entre India y Pakistán en mayo, la desinformación sobre la magnitud de los ataques alimentó la preocupación de que pudiera derivar en una guerra nuclear. Fuente: Aamir Qureshi/AFP vía Getty

El razonamiento de la IA podría abrir nuevas perspectivas sobre la guerra y las opciones militares. «Es posible imaginar el uso de la IA como herramienta de ayuda para la toma de decisiones, no para tomar decisiones, sino para sugerir diferentes líneas de acción», afirma Herbert Lin, investigador de ciberpolítica y seguridad en la Universidad de Stanford (California). Estos modelos podrían evaluar las entradas y sugerir resultados para orientar las decisiones, como el número de víctimas que podría causar un ataque en particular o qué enfoques violarían las normas internacionales de guerra.

Parece improbable que un país delegue la toma de decisiones por completo a una herramienta de IA. "Es una pésima idea entregar los códigos de lanzamiento a ChatGPT", afirma Lin. Por otro lado, muchos modelos de IA son propensos a las alucinaciones (inventar cosas) y están sesgados hacia la acción inmediata, factores que no son útiles al tomar una decisión militar crucial.

Algunas naciones con armas nucleares han indicado que mantendrán a los humanos informados sobre cualquier decisión relativa al despliegue de armas nucleares. Otras no han hecho declaraciones públicas sobre el uso de IA en la toma de decisiones nucleares.

Pero las tecnologías de IA podrían contribuir a la "niebla de la guerra" al introducir confusión sobre los motivos o capacidades del oponente, socavando así los principios bien conocidos de la disuasión nuclear. También podrían aumentar el riesgo de una escalada nuclear de otras maneras sutiles. Los modelos de IA que mejoran la capacidad de un país para detectar misiles o submarinos enemigos podrían aumentar el riesgo de que ese país lance un primer ataque para eliminar una aparente amenaza. La velocidad de procesamiento de la IA podría inducir a los líderes a una falsa sensación de confianza de que están recibiendo información precisa, cuando en realidad podrían estar filtrándose errores, afirma Lin. Esto podría incluir, por ejemplo, un exceso de confianza al interpretar los datos del radar como un ataque entrante real, en lugar de como una falsa alarma.

Detener la guerra nuclear

Entonces, ¿qué se puede hacer para reducir el riesgo de que la IA contribuya inadvertidamente a desencadenar una guerra nuclear? Los analistas afirman que los responsables políticos necesitan más información sobre las capacidades y los límites de las tecnologías de IA. El principal foro mundial para debatir la IA y la seguridad militar son las cumbres anuales sobre IA Responsable en el Ámbito Militar, que comenzaron en 2023; la próxima está programada para septiembre. La cumbre del año pasado emitió una declaración no vinculante que afirmaba que los humanos deberían controlar todos los aspectos del despliegue de armas nucleares. Sin embargo, el rápido ritmo de los avances en IA está "superando nuestra capacidad de comprender, y mucho menos de controlar, las implicaciones de la tecnología".

Es necesario abordar los riesgos de una guerra nuclear, tanto nuevos como antiguos. Se espera que los gobiernos tomen nota de las recomendaciones de los delegados de la conferencia de Chicago, que incluyen un llamamiento a las naciones para que reiteren su compromiso con una moratoria sobre los ensayos de explosivos nucleares y apoyen el desarrollo de un tratado de reducción de armas que suceda al nuevo tratado START entre Estados Unidos y Rusia, que expira el próximo año.